Depuis une dizaine d’années, le propos des politiques est de limiter les dépenses publiques, notamment avec l’aide de l’intelligence artificielle. D’après le sociologue Vincent Dubois, « Le risque n’est plus la maladie, la vieillesse ou la mort, mais la morale personnelle » en scrutant à la loupe le mode de vie des allocataires des services publics.

Ciblage des pauvres

Pour débusquer les fraudeurs, la Caisse d’allocations familiales (CAF) — qui verse notamment le RSA — expérimente des algorithmes depuis 2004, et a généralisé le data mining depuis 2011. C’est-à-dire l’exploration de données diverses, de l’état civil aux habitudes de consommation. Ainsi, la CAF consignerait pas moins de mille données différentes par allocataire !

Ces outils auraient un impact sur la vie de près de 13 millions de foyers, trente millions de personnes en tout, soit près d’un Français sur deux. Certains sont plus visés que d’autres : ainsi, une circulaire de 2012 de la CAF recommandait de cibler les personnes nées hors de l’Union européenne lors des contrôles.

Dans un rapport traitant de la lutte contre la fraude aux prestations sociales, de 2019, la députée LREM Carole Grandjean et la sénatrice Nathalie Goulet (Union centriste) plaidaient pour un élargissement des outils de data mining à Pôle emploi (qui en possède déjà plusieurs).

La "fraude sociale" par les allocataires est pourtant estimée à deux milliards d’euros, donc bien inférieure à l’évasion fiscale, évaluée entre 80 et 100 milliards d’euros par an, mais aussi au non versement de cotisations par les employeurs… Mais ces derniers ne sont pas suspectés d’abuser de la générosité publique.

Le collectif Changer de cap mène une campagne contre le déploiement d’un système algorithmique à la CAF au détriment des allocataires pauvres. Le site Basta ! relaie très largement leur action (et d’autres).

Au niveau européen, d’autres combats (victorieux !) ont été menés contre l’algorithmisation des administrations :

- en Pologne en 2014, la fondation Panoptykon a obtenu l’interdiction d’un algorithme utilisé pour profiler les demandeurs d’emploi, reconnu anticonstitutionnel car pouvant conduire à des discriminations envers des individus vulnérables comme les handicapés, les femmes seules…

- aux Pays-Bas en 2020, démantèlement de SyRI (System risk indication) qui profilait les individus à partir de données privées sur l’emploi, les dettes, l’éducation, le logement. Le tribunal a jugé qu’il violait la Convention européenne des droits de l’homme en discriminant et stigmatisant les citoyens des zones urbaines défavorisées, selon leur situation socio-économique et leur origine migratoire.

Numériser pour privatiser

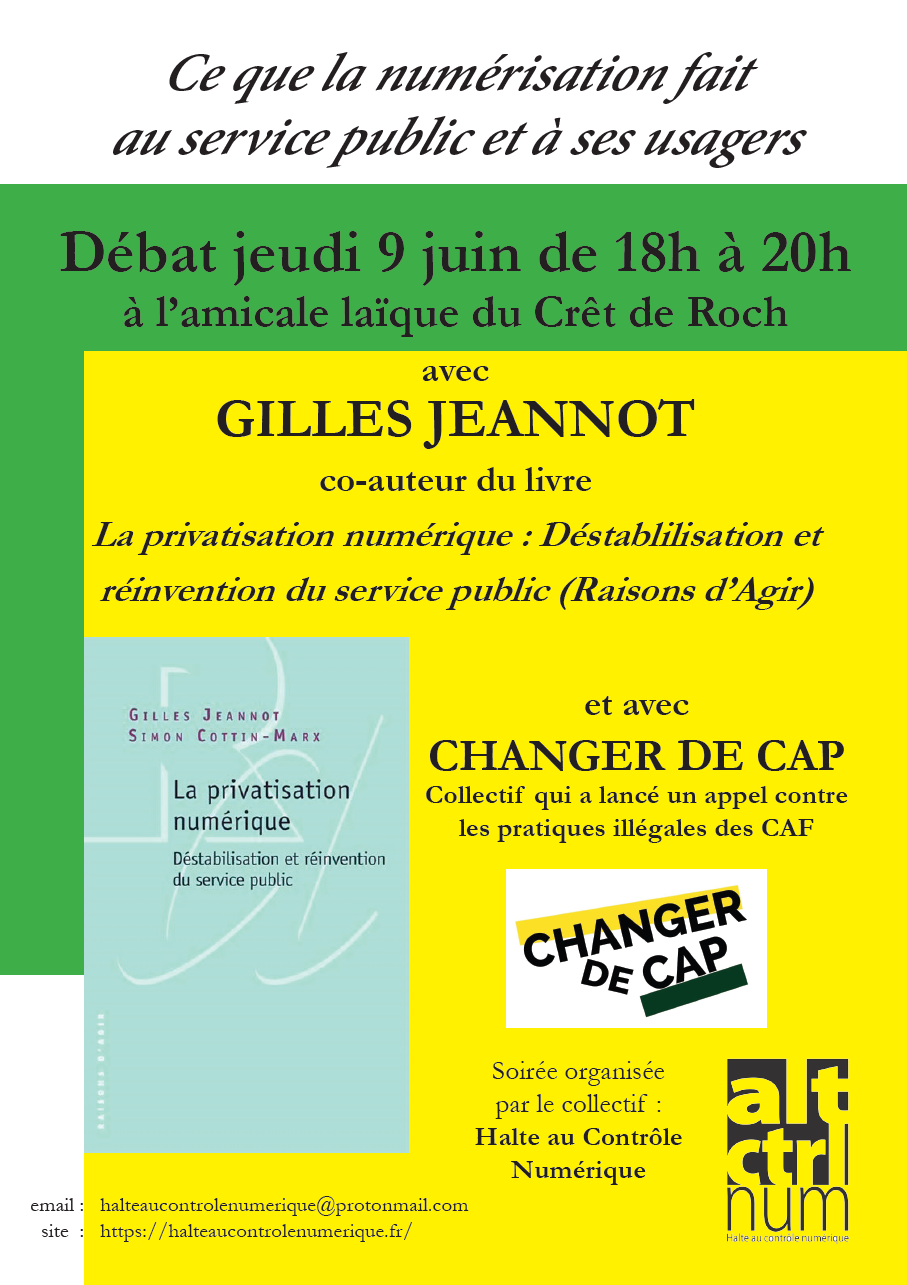

C’est donc bien une logique générale consistant à privatiser progressivement les services publics en utilisant les outils numériques. C’est ce que nous présentera Gilles Jeannot, co-auteur du livre « La privatisation numérique. Déstabilisation et réinvention du service public ».

Pour lui, la substitution d’algorithmes aux agents publics, la généralisation des mécanismes de notation et le développement de l’ubérisation des tâches touche tous les agents des services publics. Pour les usagers, cela renforce les discriminations et favorise le pistage des pauvres. Il propose une réappropriation des communs numériques, avec une mobilisation des fonctionnaires qui ainsi reconquèreraient le sens de leurs missions.

L’affiche du débat

En pdf.

Compléments d'info à l'article